เบื้องหลัง AI Search Analyzer เครื่องมือเจาะเนื้อหาคู่แข่งด้วย AI ฉบับทำเองใช้เอง

ยุคนี้ใครๆ ก็พึ่งพา AI ในการหาคำตอบกันเยอะขึ้น คำถามที่คนทำเว็บอย่างเราต้องเริ่มถามตัวเองคือ "แล้วเว็บเราในสายตาของ AI มันดีพอที่จะถูกหยิบไปเป็นคำตอบหรือยัง?" มันไม่ใช่แค่เรื่องการทำ SEO ให้ติดหน้าแรก Google อีกต่อไป แต่มันคือการทำให้อ่านง่าย มีโครงสร้างชัดเจน และตอบคำถามได้ตรงจุด (สิ่งที่เดี๋ยวนี้เรียกกันว่า AEO - AI Engine Optimization และ GEO - Generative Engine Optimization)

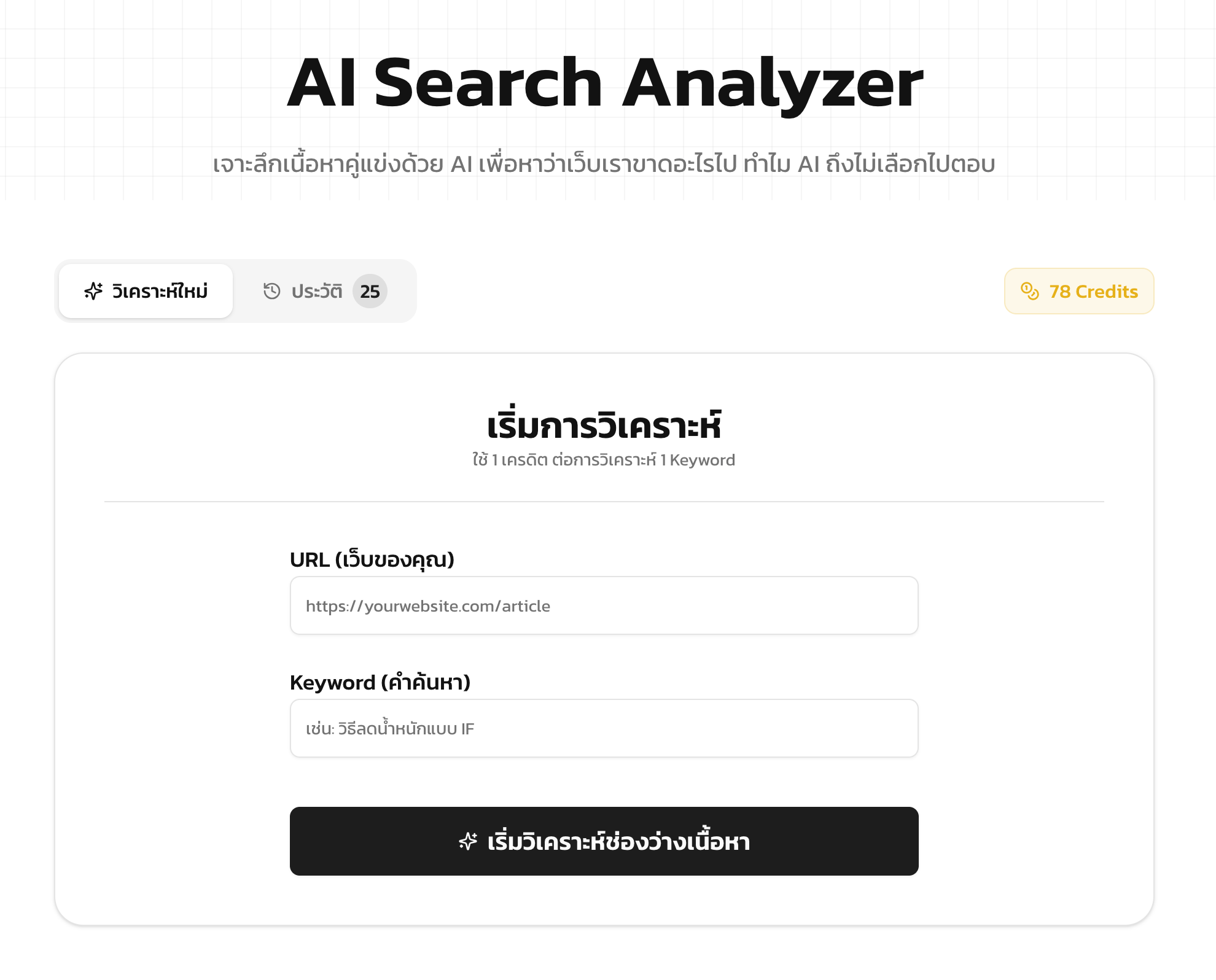

นั่นก็เป็นที่มาของโปรเจกต์: AI Search Analyzer

เครื่องมือนี้เกิดมาเพื่อตอบโจทย์เดียวเลยคือ เจาะลึกเนื้อหาคู่แข่งด้วย AI เพื่อหาว่าเว็บเราขาดอะไรไป ทำไม AI ถึงไม่เลือกไปตอบ แค่กรอก URL ที่ต้องการวิเคราะห์ กับคีย์เวิร์ดเป้าหมายลงไป ระบบจะไปกวาดข้อมูลตัว Top ในตลาดมาให้ AI วิเคราะห์แบบละเอียด บทความนี้เราจะมาดูหลังบ้าน AI Search Analyzer กันว่า Data Flow มันไหลไปยังไงบ้าง และมีขั้นตอนอะไรบ้าง

ทำไมต้องใส่ทั้ง "คีย์เวิร์ด" และ "URL" ลงไป?

เหตุผลที่เราต้องใช้ทั้งสองอย่างร่วมกัน ก็เพราะตัว "คีย์เวิร์ด" จะช่วยบอกเราว่าตอนนี้ Google หรือฟีเจอร์ AI Overview กำลังชอบดึงข้อมูลแบบไหนขึ้นมาโชว์บนหน้าผลการค้นหา ส่วน "URL" คือหน้าเว็บของเราที่อยากจะผลักดันขึ้นไป

การเอาสองอย่างนี้มาเทียบกัน จะทำให้เรารู้ว่าเมื่อเทียบกับเว็บที่ติดอันดับต้นๆ แล้ว หน้าเว็บของเรายังขาดตกบกพร่องตรงไหนไปบ้าง ทั้งในแง่ของความครบถ้วนของเนื้อหา มุมมองทางเทคนิค หรือความถูกต้องของโครงสร้าง Schema ต่างๆ

เมื่อกรอกครบแล้ว ก็กดปุ่ม "เริ่มวิเคราะห์" ได้เลย

หน้าตาผลลัพธ์ที่ได้

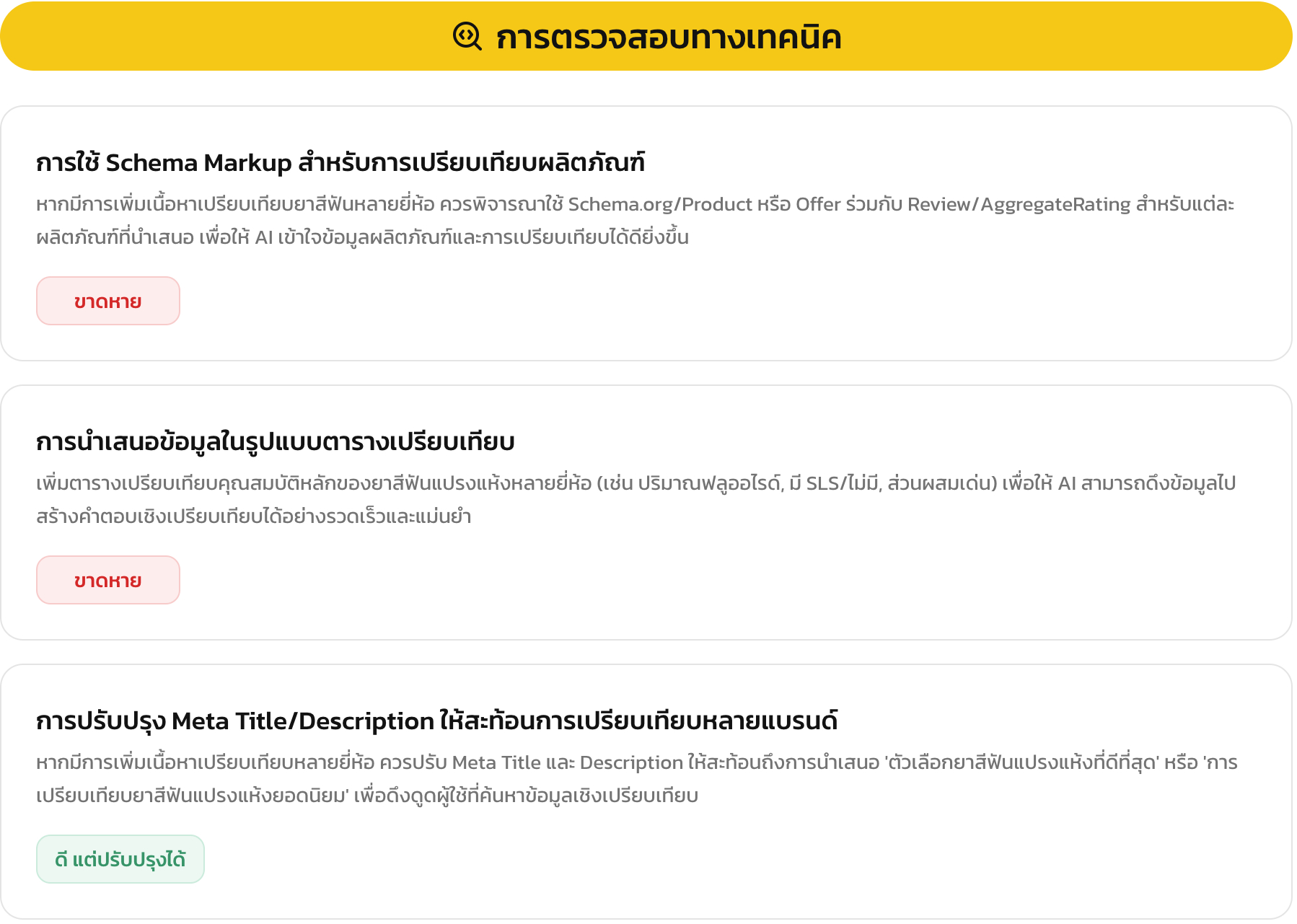

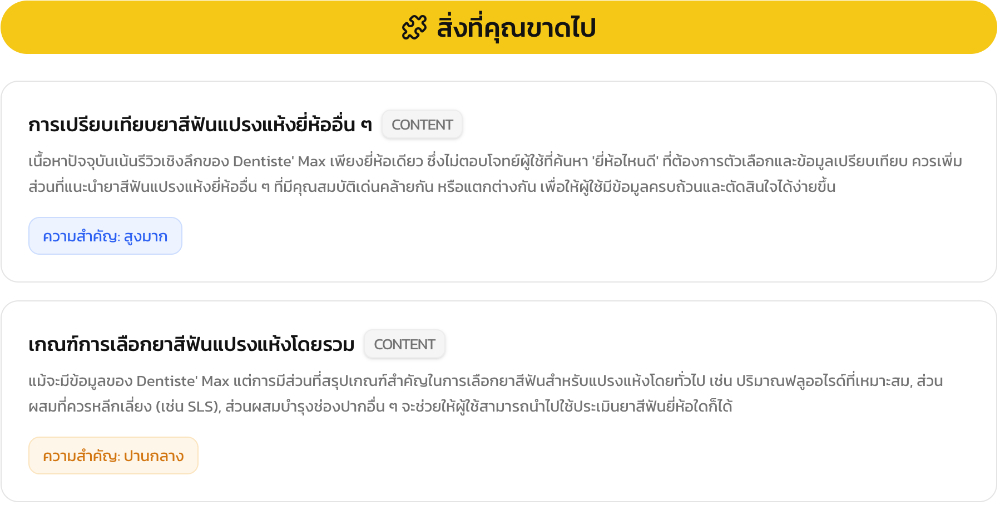

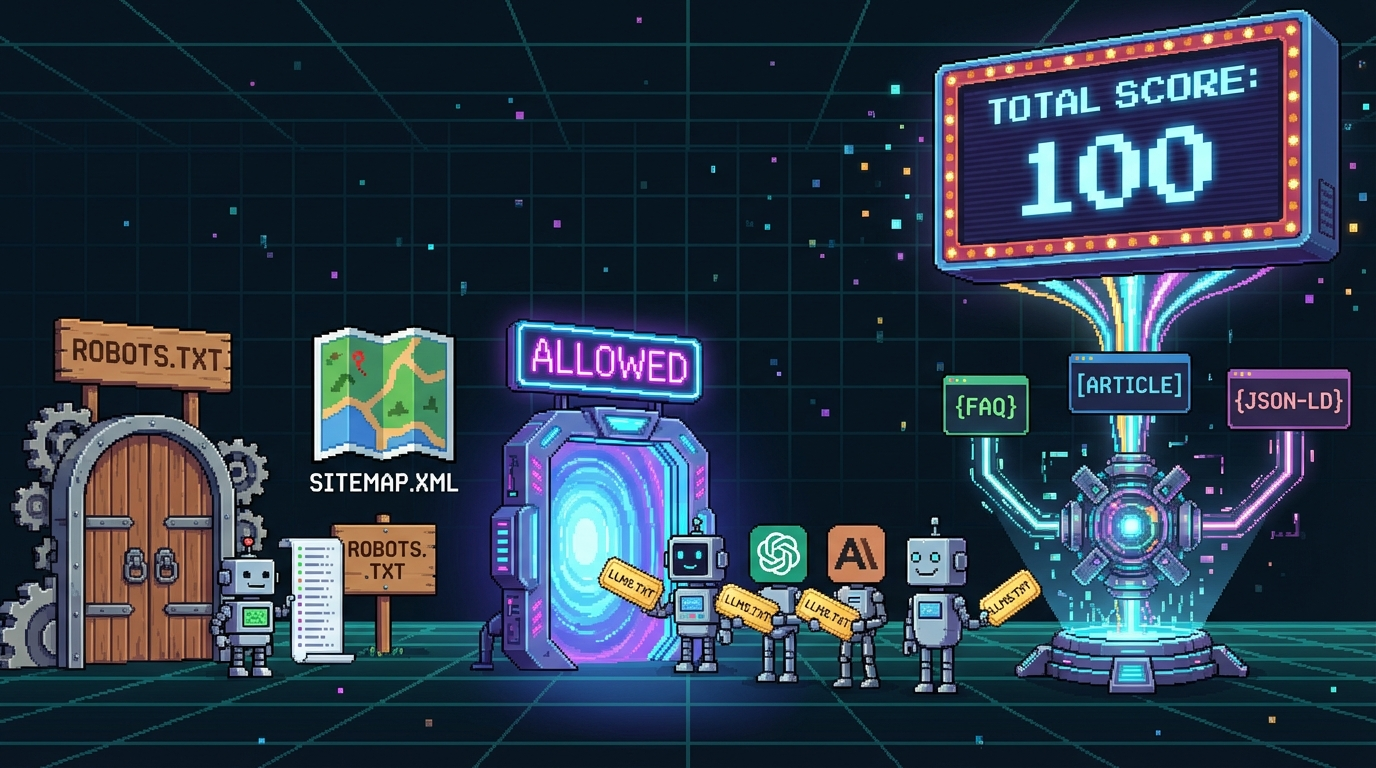

เราพยายามออกแบบไม่ให้ผลลัพธ์มันอ่านยากจนเกินไป เลยย่อยสิ่งที่โมเดลวิเคราะห์ออกมาเป็นส่วนๆ ตามนี้:

คะแนนความน่าสนใจ

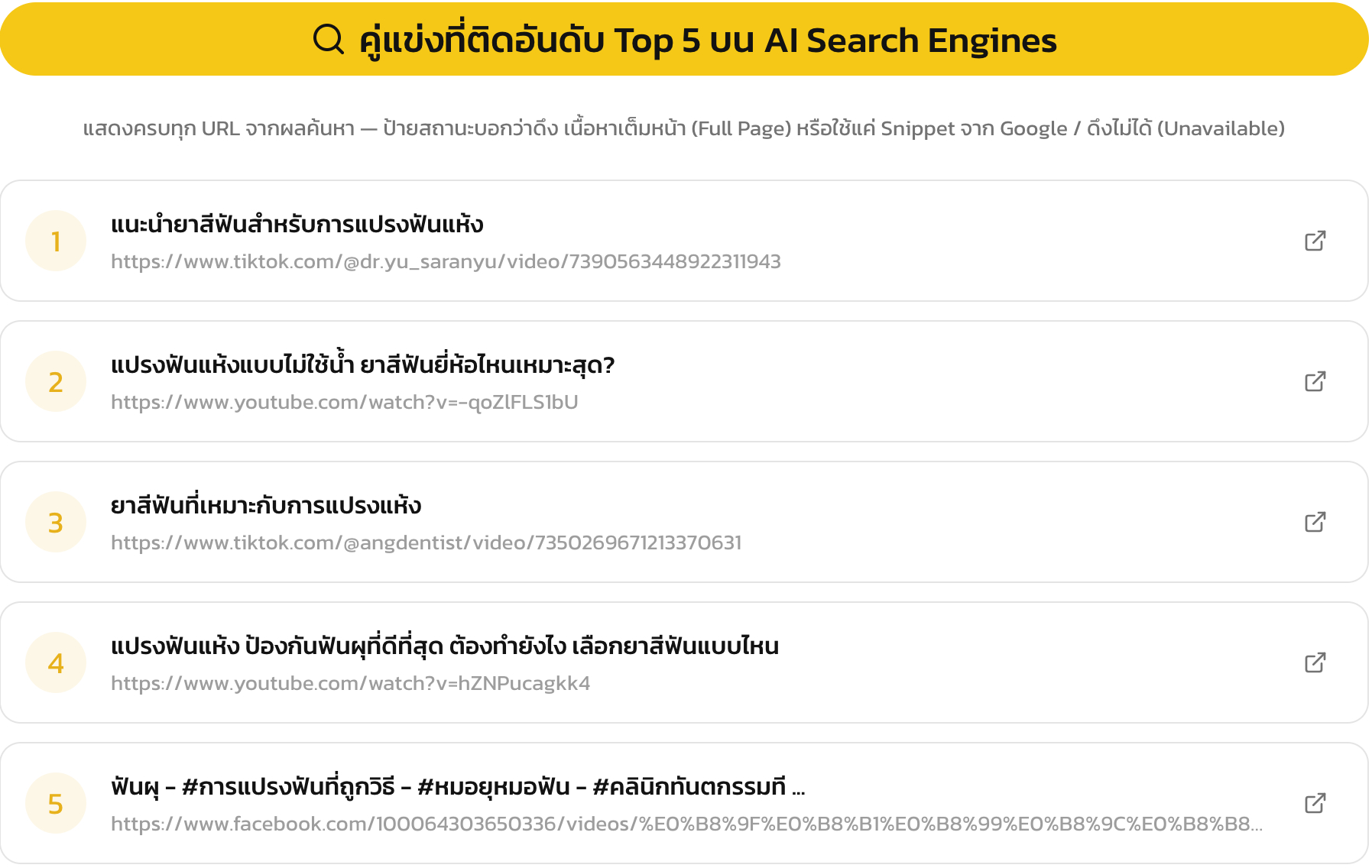

คู่แข่งที่ติดอันดับ Top 5 บน AI

ตรวจสุขภาพหลังบ้าน

สิ่งที่คุณขาดไป

คำแนะนำที่ทำตามได้เลย

ต่อท่อประมวลผล (The Pipeline)

สำหรับเบื้องหลังการทำงาน ขอเล่า Flow การทำงานหลังบ้านแบบพอเห็นภาพได้ไม่ยาก:

เข้าสู่ระบบ เพื่อใช้งาน

สืบหาคู่แข่ง Top 5

Serper.dev เพื่อขอผลค้นหาจาก Google (ตั้งค่าเป็นภาษาไทยนะ) กรองเอาพวกลิงก์ที่มักจะไปโผล่ใน AI Overview มาให้ลุ้นก่อน ถ้าไม่ครบ 5 เว็บไซด์ ค่อยเอาผล Organic ตามปกติมาเติมเข้าไปส่งหน่วยรบไปสกัดเนื้อหา

Cloud Run ให้ใช้ Playwright (Headless Browser) ไปไล่เปิดดูเนื้อหาเว็บเป้าหมายและคู่แข่งทีละเว็บ ข้อดีคือมันสามารถแกะพวก Metadata และพวก Schema ชนิดต่างๆ ออกมาได้ด้วยMarkdown เตรียมไว้ประมวลผลด้วยสมอง Gemini

Markdown ทั้งหมด ห่อรวมเป็น Prompt ส่งให้ Gemini 2.5 Flash ช่วยย่อยข้อมูลและตอบกลับมาเป็นรูปแบบ JSON ที่วางโครงสร้างไว้ โดยเราตั้งกฎไว้ใน Prompt ชัดเจนว่า "ให้วิเคราะห์จากข้อมูลที่ให้ไปเท่านั้น ห้ามมโน"บันทึกผล

JSON ทั้งหมดลงฐานข้อมูลของระบบ Supabase เพื่อให้ผู้ใช้สามารถคลิกเข้ามาดูประวัติย้อนหลังได้สบายๆ ไม่ต้องมาสั่งรันและเสียเครดิตใหม่

ข้อจำกัดที่อยากบอกไว้ก่อน

คำถามที่พบบ่อย (FAQ)

Related Posts

แนวทางการปรับแต่งเว็บไซต์เพื่อรองรับ AI Search ในปี 2026: จากการติดอันดับ สู่การถูกอ้างอิง

เมื่อพฤติกรรมการค้นหาเปลี่ยนจากลิงก์ไปสู่คำตอบจาก AI เราจะปรับตัวอย่างไร? สรุปแนวคิด SEO, AEO และ GEO เพื่อให้เว็บไซต์ของเรายังคงถูกค้นพบและน่าเชื่อถือในปี 2026

Git 103: แตกกิ่งก้านสาขา ทำงานร่วมกับชาวแก๊ง (Branch & Merge เบื้องต้น)

มาถึงตอนสุดท้าย! เรียนรู้ทักษะที่สำคัญที่สุดของ Git สำหรับการทำงานเป็นทีม นั่นคือการ "แตกกิ่ง" หรือ Branch เราจะมาดูกันว่าจะสร้างเส้นทางทำงานของตัวเองแยกออกมายังไงไม่ให้กระทบโปรเจคหลัก และเอากลับมารวมกันเมื่อทำเสร็จ

Git 102: ส่งการบ้านขึ้น Cloud (เมื่อโค้ดไม่ได้มีแค่เราคนเดียว)

ในตอนที่แล้วเราสร้าง "จุดเซฟ" ให้โค้ดในเครื่องตัวเองได้แล้ว ตอนนี้ถึงเวลาเอาโค้ดของเราไปเก็บไว้บน Cloud ด้วย GitHub กัน! มาเรียนรู้วิธีเชื่อมต่อและใช้คำสั่ง push, pull, clone เพื่อให้ทำงานจากที่ไหนก็ได้

Git 101: ติดตั้งไทม์แมชชีนให้โค้ดของเรา (ใช้คนเดียวยังไงให้รอด)

บอกลา Project-Final-v2.zip! มาเรียนรู้วิธีใช้ Git เป็น "จุดเซฟ" ให้กับโปรเจคของเรากันดีกว่า บทความนี้จะพามือใหม่ติดตั้งและใช้คำสั่งพื้นฐาน 3 อย่างที่จำเป็นที่สุดในการเริ่มควบคุมเวอร์ชันโค้ดของตัวเอง